Il Garante dice stop a Chat GPT fino al 30 aprile, ma i rischi collegati alle AI sono più complessi e variegati

Dopo la grande esplosione di Chat GPT nel nostro paese, con i suoi mille utilizzi che improvvisamente diventavano interessanti e insieme inquietanti, è arrivato lo stop del Garante Privacy: l’Intelligenza Artificiale è intelligentissima ma non è in grado, non ancora, di gestire i dati personali e quindi il suo utilizzo è stato bloccato fino al 30 aprile.

Entro quella data, OpenAI (la società che c’è dietro Chat GPT) dovrà adempiere alla prescrizioni imposte dal Garante: informativa, diritti degli interessati, utenti e non utenti, base giuridica del trattamento dei dati personali per l’addestramento degli algoritmi con i dati degli utenti. In soldoni, Chat GPT dovrà chiedere esplicitamente il consenso per utilizzare i nostri dati personali al fine di addestrare il suo algoritmo a diventare sempre più simile all’essere umano.

Nel frattempo, varie Intelligenze Artificiali stanno producendo contenuti visivi sempre più perfetti e simili alla realtà, in grado di ingannare l’occhio umano (soprattutto quello con meno spirito critico): era credibile l’immagine di Papa Francesco con un piumino da trapper? Per chi sa che il Pontefice è reduce da un ricovero in ospedale e ormai si sposta quasi sempre in sedia a rotelle, probabilmente no. Ad una prima occhiata, assolutamente si. Così come a un occhio non esperto di politica internazionale sarebbe sembrato credibile Putin che bacia la mano di Xi Jinping e a qualcuno che non conosca benissimo Milano, addirittura le immagini del funerale di Silvio Berlusconi in Duomo (chiariamo ovviamente che si tratta di immagini false, create con Intelligenza Artificiale e che circolano sul web).

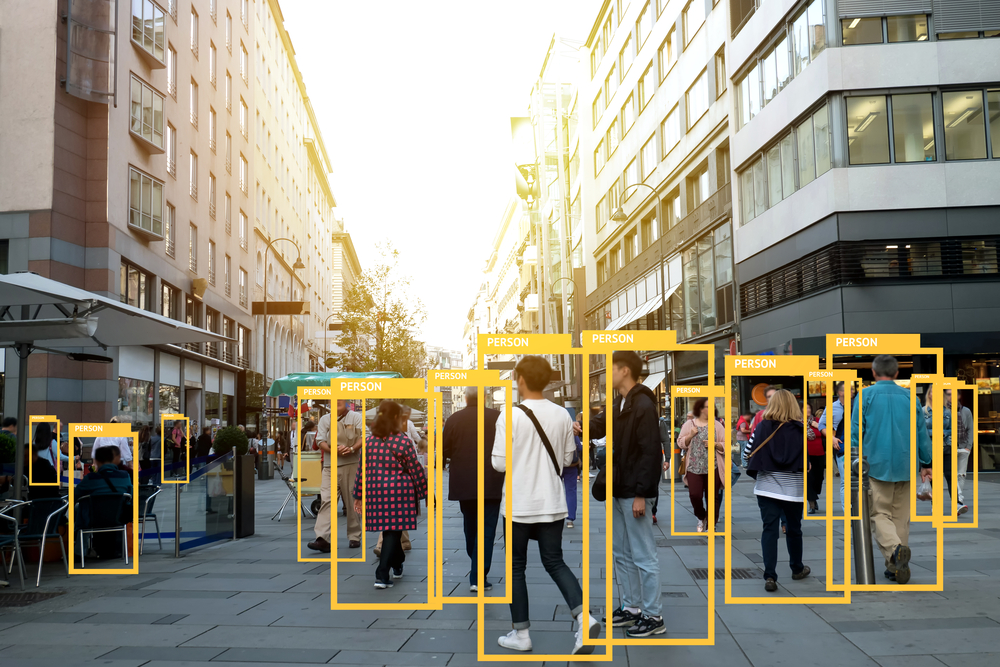

Il mondo che ci aspetta è sempre più questo: foto e video non saranno più garanzia di verità e purtroppo non sarà la barriera -legittima e sacrosanta- della privacy a proteggerci.